Hoe voorkom je dat je risico’s loopt bij het inzetten van AI in je recruitmentproces?

Tijdens het werving- en selectieproces gebruik maken van AI kent vele voordelen. Het proces kan veel sneller en efficiënter verlopen. Dat bespaart kosten en verbetert de candidate experience. Echter, er liggen ook gevaren op de loer. Zo kan het algoritme van een AI-tool (ook) bevooroordeeld zijn en moet rekening gehouden worden met privacy-issues. Hoe voorkom je dat je met AI uit de bocht vliegt?

Het inzetten van AI voor recruitment maakt een stormachtige ontwikkeling door. Anderhalf jaar geleden had nog niemand van ChatGPT gehoord. Dat wordt nu massaal ingezet voor het opstellen van functieprofielen, het schrijven van vacatureteksten en het matchen van cv’s met functieprofielen. AI-tools kunnen ook ingezet worden om te chatten met kandidaten, het inplannen van afspraken of het voorspellen van toekomstige prestaties.

Lees ook: ChatGPT biedt interessante mogelijkheden voor recruiters

De risico’s van het inzetten van AI-tools voor recruitment

Het inzetten van AI-tools voor recruitment is niet geheel risicoloos. Sterker nog, experts voorzien vele risico’s, evenals sollicitanten die vrezen dat AI-tools bevooroordeeld zijn. Dat is ook de reden dat de EU bij het uitwerken van de AI Act, HR- en recruitmentsystemen in de categorie ‘hoog risico’ heeft geplaatst. Aanbieders (en gebruikers) van AI-systemen met hoog risico moeten volgens de AI Act aan strenge eisen voldoen.

Bij risico’s kun je denken aan:

Privacy-issues

Als AI tools worden ingezet worden data gebruikt voor analyse. Deze data kunnen misbruikt worden, er kunnen datalekken zijn of onzorgvuldige omgang met data waardoor de AVG overtreden wordt.

Gebrekkig inzicht in beslissingen/uitkomsten

Lang niet altijd is duidelijk hoe de complexe algoritmes van AI werken. Hoe komen beslissingen en uitkomsten van de tool tot stand? Dit betekent dat het niet altijd duidelijk is waarom bijvoorbeeld kandidaten worden afgewezen. Dat maakt ook de terugkoppeling aan afgewezen kandidaten moeilijk.

Discriminerend algoritme

Hoewel algoritmes bias kunnen verminderen bestaat het risico dat bias juist versterkt wordt. Dat ondervond bijvoorbeeld Amazon al jaren geleden. Het algoritme dat Amazon gebruikte om software-developers te selecteren sloot vrouwen bij voorbaat uit. Als de trainingsdata van de AI tool fouten bevat, dan worden deze (mogelijk) versterkt. Dit kan leiden tot discriminatie en uitsluiting.

De candidate experience verslechterd

Natuurlijk kan AI het sollicitatieproces soepeler laten verlopen. Echter, het kan er tevens toe leiden het proces voor de sollicitant onpersoonlijk en kil aanvoelt. Het gebrek aan menselijk contact kan sollicitanten het gevoel geven dat ze niet gewaardeerd worden, waardoor ze (sneller) afhaken.

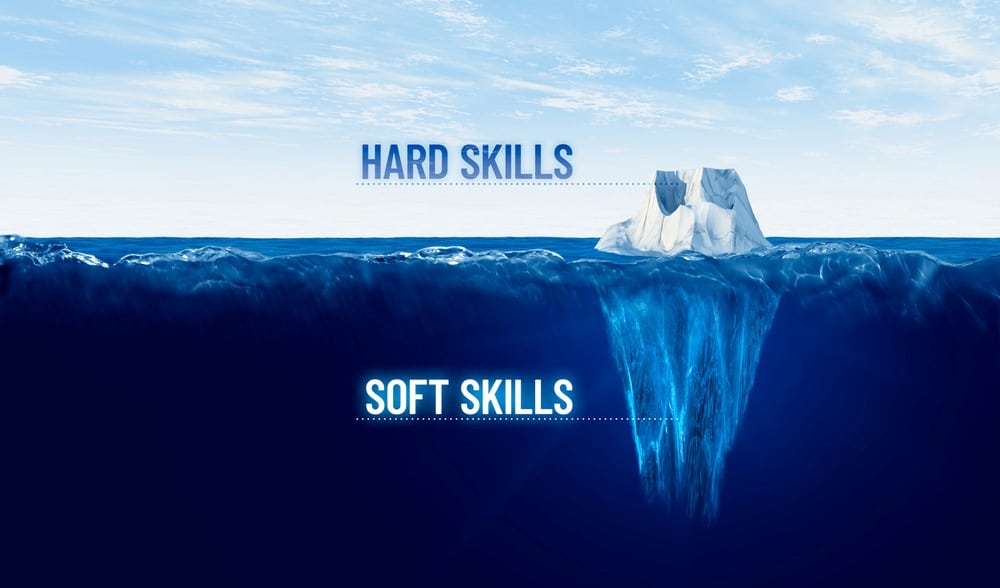

Teveel nadruk op hard skills

Een AI tool matcht (met name) op harde criteria in het functieprofiel en het cv die overeen komen. Daardoor worden bij voorbaat kandidaten uitgesloten die wellicht enkele (aan te leren!) skills missen, maar die juist op soft skills een uitstekende match zijn.

Op een goede manier AI in je recruitmentproces integreren

Je wilt voorkomen dat je risico’s loopt door het inzetten van AI in je recruitmentproces. Hieronder volgen een aantal best practices die helpen met het op een goede manier integreren van AI in het werving- en selectieproces.

1. Zorg voor naleving van wet- en regelgeving

Dat zou natuurlijk vanzelfsprekend moeten zijn. Maar vaak is de kennis van relevante wet- en regelgeving te beperkt of wordt er niet strak genoeg mee omgegaan. In Nederland moet rekening gehouden worden met de AVG. In de nabije toekomst moet ook de (Europese) AI Act geïmplementeerd worden. Om aan de regels te voldoen moet je als organisatie begrijpen hoe AI-tools gegevens van kandidaten verzamelen, opslaan en verwerken.

2. Zorg voor transparantie

Transparantie is echt cruciaal bij het inzetten van AI bij recruitment. Organisaties moeten duidelijk communiceren aan kandidaten hoe AI wordt gebruikt in het wervingsproces en welke gegevens worden verzameld. Vermeld daarbij ook over hoe beslissingen worden genomen. Door open te zijn over het gebruik van AI, kunnen organisaties de zorgen van kandidaten wegnemen.

3. Train management op het gebied van AI

Verantwoord gebruik van AI begint met kennis. Kennis van wat AI is en kan en wat de kansen en risico’s zijn. Managers, recruiters en HR-professionals moeten echt inzicht krijgen in de ethische implicaties van AI, hoe AI-gebaseerde aanbevelingen te interpreteren en wanneer automatische beslissingen te negeren. Opleiding en training zorgt ervoor dat managers en recruiters AI-tools effectief kunnen beheren, verantwoordelijk kunnen gebruiken en een menselijk perspectief in wervingsbeslissingen behouden. Zo borg je dat efficiënter werken en de menselijke maat hand in hand gaan.

4. Regelmatige audits

Het is essentieel om AI-tools regelmatig te controleren op niet-discriminerende praktijken. Daartoe zijn regelmatige audits van AI-hulpmiddelen noodzakelijk. Zoals in het bovenstaande voorbeeld van Amazon al bleek sluipt discriminatie er onbewust snel in. Door de algoritmes en de gegevens die ze gebruiken te onderzoeken, kunnen organisaties eventuele vooroordelen identificeren en corrigeren. Deze audits worden liefst uitgevoerd door materiedeskundigen.

5. Mens centraal

Natuurlijk heeft het inzetten van AI voordelen. Dat mag echter nooit ten koste gaan van de menselijke maat. Kandidaten willen het gevoel hebben dat zij eerlijk behandeld worden en dat er echte belangstelling is voor hen. Dat kan alleen een mens! Persoonlijke interactie, het beoordelen van de soft skills en het opbouwen van vertrouwen is mensenwerk. Organisaties moeten ervoor zorgen dat AI wordt gebruikt om het wervingsproces te versterken, niet om het te vervangen. Want voor empathie heb je toch echt een mens nodig.

Uiteindelijk gaat het om de balans. Het werven en selecteren van collega’s is gewoon deels mensenwerk. Dat het efficiënter kan met een AI tool is mooi meegenomen. Dat moet je als organisatie gebruiken, daarbij dus in het oog houdend dat je te maken hebt met mensen van vlees en bloed. Dat betekent ook steeds kritisch blijven kijken naar algoritmes, voldoen aan wet- en regelgeving het opbouwen en onderhouden van kennis over (de werking van) AI.